🔍

Auto-hébergement d'un LLM en entreprise

Déployer l'IA générative dans votre infrastructure

Publié le 4 novembre 2025

Les LLM open source comme Llama, Mistral ou Qwen révolutionnent l'accès à l'IA générative en entreprise. L'auto-hébergement d'une IA générative offre souveraineté numérique, conformité RGPD et maîtrise des coûts à long terme. Cette formation vous apprend à déployer et exploiter ces modèles dans votre infrastructure, en allant du poste de travail individuel jusqu'au cloud dédié.

Au programme : stratégies de déploiement, dimensionnement matériel, évaluation des coûts, et mise en place d'une plateforme IA complète, qui peut remplacer ChatGPT ou Mistral (systèmes RAG, interfaces utilisateur, monitoring). Vous manipulerez des LLM directement sur votre machine avec LM Studio et Ollama, et analyserez des cas d'usage réels d'entreprises.

À l'issue de cette formation, vous aurez des éléments pour dimensionner et déployer une infrastructure LLM en interne. Vous saurez évaluer les coûts, choisir le matériel adapté, et mettre en production vos propres modèles de langage en toute autonomie.

Durée

1 jour

Modalités

À distance (présentiel possible en intra-entreprise)

Au maximum 10 participants

Prix

Sur devis en intra-entreprise

Prochaines sessions

Cette formation est une introduction pratique à l'auto-hébergement de LLM en entreprise, couvrant l'ensemble de la chaîne technique : de l'exécution locale au déploiement cloud, en passant par le dimensionnement de l'infrastructure et l'évaluation des coûts.

L'enjeu est de maîtriser les aspects techniques, organisationnels et économiques pour réussir votre projet d'auto-hébergement de LLM en entreprise.

- Identifier les différentes stratégies d'auto-hébergement de LLM (local, on-premise, cloud dédié)

- Dimensionner l'infrastructure matérielle (CPU, GPU, RAM, stockage) selon le modèle et la charge

- Déployer et exécuter un LLM open source sur machine locale avec LM Studio ou Ollama

- Évaluer les coûts totaux d'un projet d'auto-hébergement et les comparer aux API cloud

- Sélectionner le modèle de langage adapté aux contraintes de votre organisation

- Découvrir l'écosystème d'outils constituant une plateforme LLM : RAG, interface utilisateur, monitoring

- Élaborer une stratégie de déploiement et une roadmap technique pour votre projet

La formation est ouverte aux décideurs techniques et équipes DevOps qui souhaitent maîtriser l'auto-hébergement de LLM en entreprise.

Des expérimentations seront menées en local sur votre machine personnelle.

- Posséder une culture générale en infrastructure IT et cloud computing

- Comprendre les concepts de base de l'intelligence artificielle générative (utiliser un modèle de langage LLM pour générer du contenu) et des agents IA (utilisation d'outils dans une plateforme IA, par exemple pour la recherche d'information sur Internet)

- Posséder des notions de ligne de commande et d'administration système (prérequis apprécié mais non obligatoire)

- Apporter un ordinateur portable (Windows, macOS ou Linux) avec au minimum 16 Go de RAM, un espace disque disponible de 20 Go minimum et les droits d'installation de logiciels sur la machine

- Posséder une connexion Internet stable compatible avec le téléchargement de modèles d'intelligence artificielle open source (jusqu'à plusieurs gigaoctets) et le suivi de la formation en visio-conférence

- Avoir une maîtrise suffisante de l'anglais pour lire des documentations techniques.

Aucune connaissance en science de données ou en mathématiques n'est nécessaire.

Un questionnaire d'auto-évaluation sera envoyé à chaque participant au début de la formation pour nous permettre d'évaluer au mieux son niveau, ses besoins et ses attentes concernant la formation.

Programme de la formation

- 1. Introduction : panorama de l'auto-hébergement de LLM

- État de l'art des LLM open source (Llama, Mistral, Qwen, DeepSeek...)

- Avantages et inconvénients de l'auto-hébergement vs solutions cloud propriétaires

- Enjeux de souveraineté numérique, conformité RGPD et sécurité des données

- 2. Exécution d'un LLM sur machine personnelle (1h15)

- Pratique : installation et premiers pas avec LM Studio ou Ollama

- Téléchargement et exécution d'un modèle léger (Llama 3.2, Mistral 7B...)

- Comprendre les formats de quantification (GGUF, GPTQ) et leur impact sur les performances

- Limites de l'exécution locale : RAM, CPU vs GPU, latence

- 3. Déploiement on-premise en entreprise (1h15)

- Architecture d'une infrastructure on-premise pour LLM

- Dimensionnement matériel : choix des GPU (NVIDIA A100, H100, RTX series...)

- Besoins en CPU, RAM et stockage selon la taille du modèle

- Solutions de conteneurisation (Docker, Kubernetes) et orchestration

- Cas d'usage : banques, santé, administrations publiques

- 4. Offres cloud dédiées pour l'auto-hébergement (1h)

- Panorama des fournisseurs : Scaleway, OVHcloud, Google Cloud Platform, AWS Bedrock, Azure ML

- Instances GPU dédiées vs partagées : avantages, coûts et performances

- Comparaison des offres françaises et européennes (souveraineté)

- Démonstration : déploiement d'un LLM sur une instance cloud GPU Intégration de serveurs MCP existants pour les fonctions fournies par des tiers (API, programmes).

- 5. Évaluation des coûts et choix de solution (1h)

- Méthode de calcul du TCO (Total Cost of Ownership) pour l'auto-hébergement

- Coûts d'investissement matériel vs coûts d'exploitation cloud

- Seuils de rentabilité selon le volume d'utilisation

- Exercice pratique : évaluer le coût de votre projet d'entreprise

- Grille de décision : quelle solution pour quel contexte ?

- 6. Écosystème d'outils complémentaires (1h)

- Systèmes RAG (Retrieval-Augmented Generation) : architecture et cas d'usage

- Interfaces utilisateur : Open WebUI, Chatbot UI, solutions custom

- Monitoring et observabilité : métriques clés, outils de supervision

- Gestion des prompts, versioning de modèles et MLOps

- 7. Synthèse et élaboration de roadmap (30 min)

- Retours d'expérience d'entreprises ayant déployé des LLM en interne

- Élaboration d'une roadmap technique pour votre organisation

- Questions-réponses et échanges avec le formateur

La formation alterne présentations théoriques et démonstrations pratiques. Vous découvrirez comment manipuler des LLM open source directement sur votre machine. Vous analyserez des cas d'usage réels, et travaillerez sur le dimensionnement d'une infrastructure adaptée à votre organisation.

Notre approche pédagogique s'appuie sur l'alternance de présentations par le formateur et de mises en pratique accompagnées sur un projet fil rouge. A l'issue de la formation, vous conserverez le code et tous les supports de formation.

Dimensionnement d'infrastructure LLM

Nous allons dimensionner et chiffrer une infrastructure d'auto-hébergement étape par étape, en appliquant les concepts vus en formation.

Vous choisirez le modèle de langage adapté à vos contraintes (performance, coût, confidentialité), dimensionnerez l'infrastructure matérielle (GPU, RAM, stockage), et évaluerez les coûts d'investissement et d'exploitation.

Votre formateur installera et exécutera un modèle open source léger (Llama 3.2 3B ou Mistral 7B) sur sa propre machine via LM Studio ou Ollama.

Si votre ordinateur le permet, vous pourrez en faire de même sur votre propre machine. Cette mise en pratique permet de comprendre les contraintes réelles d'exécution avant de passer à des déploiements plus ambitieux.

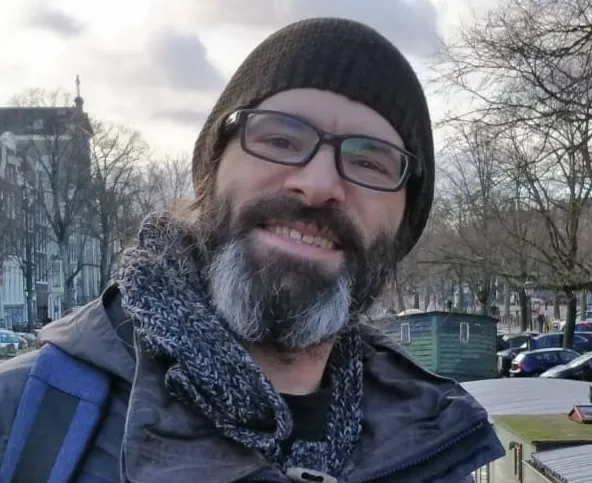

Votre formateur

Nicolas Karageuzian est Architecte Solutions IA. Après 20 ans d'expérience entre développement et production, il s'est spécialisé depuis plus de 8 ans en infrastructure IA et cloud computing, et dans le déploiement de modèles de langage en production.

Il accompagne les entreprises sur leurs projets MLOps, notamment dans les secteurs du transport et du tourisme, en concevant des architectures robustes et scalables.

Attaché à l'optimisation des performances, il a aidé plusieurs organisations à migrer vers l'auto‑hébergement, permettant des économies de 40 à 60 % par rapport aux API propriétaires.

Contributeur actif à des projets open source, il partage ses retours d'expérience lors de conférences techniques et enseigne à l'université.

Contactez-nous

This site is protected by reCAPTCHA and the Google Privacy Policy and Terms of Service apply.

FAQ

-

L'auto-hébergement de LLM est-il vraiment plus économique que l'utilisation d'API cloud comme OpenAI ou Claude ?

Cela dépend fortement de votre volume d'utilisation et de votre horizon temporel. Pour des usages intensifs et récurrents, l'auto-hébergement peut générer des économies de 40 à 60% par rapport aux API propriétaires, une fois l'investissement initial amorti. En revanche, pour des volumes faibles ou des phases d'expérimentation, les API cloud restent plus avantageuses car elles ne nécessitent aucun investissement matériel. La formation vous donnera justement les outils pour réaliser cette analyse coût-bénéfice selon votre contexte spécifique, en prenant en compte les coûts d'infrastructure, de maintenance et d'exploitation. -

Faut-il être développeur ou avoir des compétences avancées en IA pour suivre cette formation ?

Non, la formation s'adresse avant tout aux décideurs techniques et équipes DevOps qui ont une culture générale en infrastructure IT et cloud. Vous n'avez pas besoin d'être expert en machine learning ou en développement d'algorithmes d'IA. Des notions de ligne de commande et d'administration système sont appréciées mais non obligatoires. L'objectif est de vous donner les clés pour dimensionner, déployer et gérer une infrastructure LLM en production, pas de former des data scientists. Un questionnaire d'auto-évaluation vous sera envoyé en début de formation pour adapter le contenu à votre niveau. -

Ai-je besoin d'un GPU puissant sur mon ordinateur pour suivre la formation ?

Non, un GPU n'est pas obligatoire pour suivre la formation. Le formateur réalisera les démonstrations sur sa propre machine, et vous pourrez observer les manipulations en direct. Si vous souhaitez tester vous-même l'exécution d'un modèle léger (comme Llama 3.2 3B), un ordinateur avec 16 Go de RAM suffira, même sans GPU dédié. L'objectif est de comprendre les concepts et contraintes de déploiement plutôt que d'obtenir des performances maximales. Les aspects liés au dimensionnement GPU pour des déploiements en production seront abordés dans la partie théorique. -

J'utilise très peu le terminal en ligne de commande, comment faire ?

La formation est conçue pour être accessible même si vous n'êtes pas familier de l'utilisation de la console sur votre système. Le tutoriel de Mozilla (en anglais) fournit une bonne introduction aux lignes de commande dans le terminal.

Nous proposons des formations courtes dans le domaine du développement web fullstack et du développement LLM, à destination des développeurs JavaScript et Python.

Nous accompagnons aussi les dirigeants, cadres et managers techniques via des formations qui leur sont dédiées.